Todo apuntaba a que tendríamos que esperar bastante para disfrutar de una nueva Raspberry Pi: los problemas de fabricación y distribución precisamente habían hecho que durante meses conseguir una Raspberry Pi 4 a precios "normales" fuera casi imposible, y eso planteaba también problemas para una potencial sucesora.

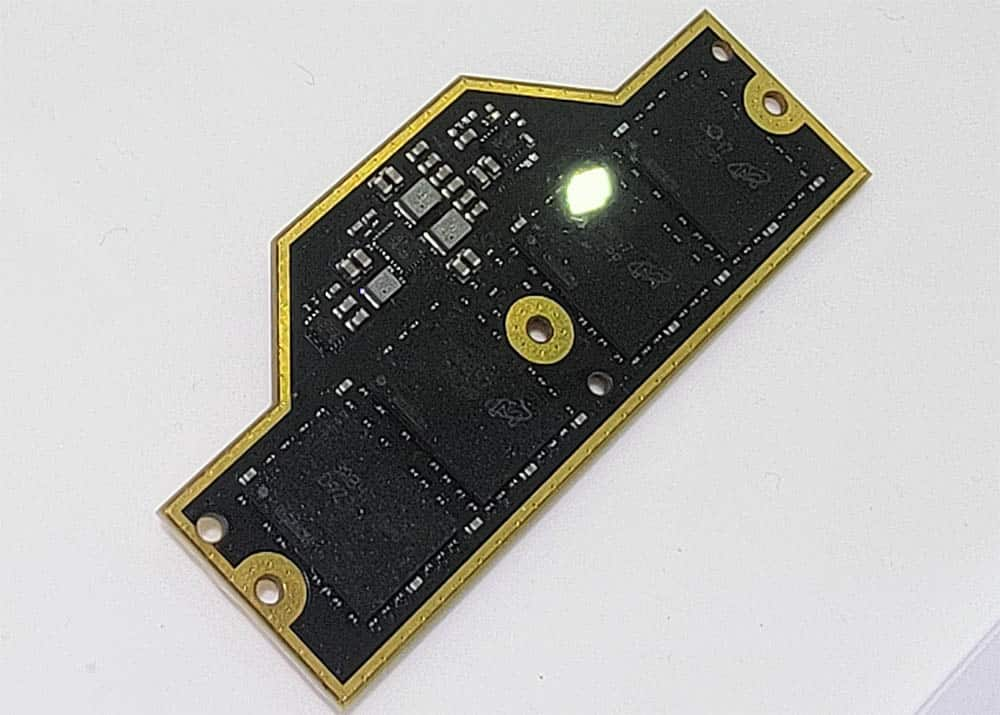

Sin embargo esa sucesora acaba de llegar: acaba de anunciarse la Raspberry Pi 5, y lo hace con una novedad especialmente notable: incluye un SoC fabricado por la propia empresa. Atentos, que esto promete.

Todo apuntaba a que tendríamos que esperar bastante para disfrutar de una nueva Raspberry Pi: los problemas de fabricación y distribución precisamente habían hecho que durante meses conseguir una Raspberry Pi 4 a precios "normales" fuera casi imposible, y eso planteaba también problemas para una potencial sucesora.

Sin embargo esa sucesora acaba de llegar: acaba de anunciarse la Raspberry Pi 5, y lo hace con una novedad especialmente notable: incluye un SoC fabricado por la propia empresa. Atentos, que esto promete.

Ficha técnica de la Raspberry Pi 5

RASPBERRY PI 5CPUBroadcom BCM2712Quad-core Arm Cortex-A76 a 2,4 GHzGPUVideoCore VIISoporta OpenGL ES 3.1 y Vulkan 1.2RAM4 / 8 GB LPDDR4XCONECTIVIDADWi-Fi 5Bluetooth 5.0 / BLEPUERTOS2 x micro HDMI (hasta 2 x 4K 60Hz simultáneas)2 x USB 3.02 x USB 2.01 x Gigabit Ethernet con PoE opcional2 x MIPI de 4 pistas1 x PCIe 2.0 x11 x GPIO 40 pinesALMACENAMIENTORanura microSDOpción para unidades SSD M.2 (vía HAT opcional)OTROSBotón de encendido y apagadoRTC (Real Time Clock)Accesorios opcionales diversosPRECIORaspberry Pi 5 (4 GB RAM): 59,95 eurosRaspberry Pi 5 (8 GB RAM): 79,95 euros

Mucho más potente, mucho más versátil

Esas mejoras llegan también al subsistema de entrada y salida, que cuenta con un mayor ancho de banda. Gracias a ello es posible usar la Raspberry Pi 5 conectada a dos monitores 4K a 60 Hz de forma simultánea, y también es posible disfrutar del doble de ancho de banda en los puertos USB 3.0

Hay otra buena noticia: este SoC también habilita el uso de un puerto PCIe x1 para poder conectar dispositivos PCIe y también NVMe.

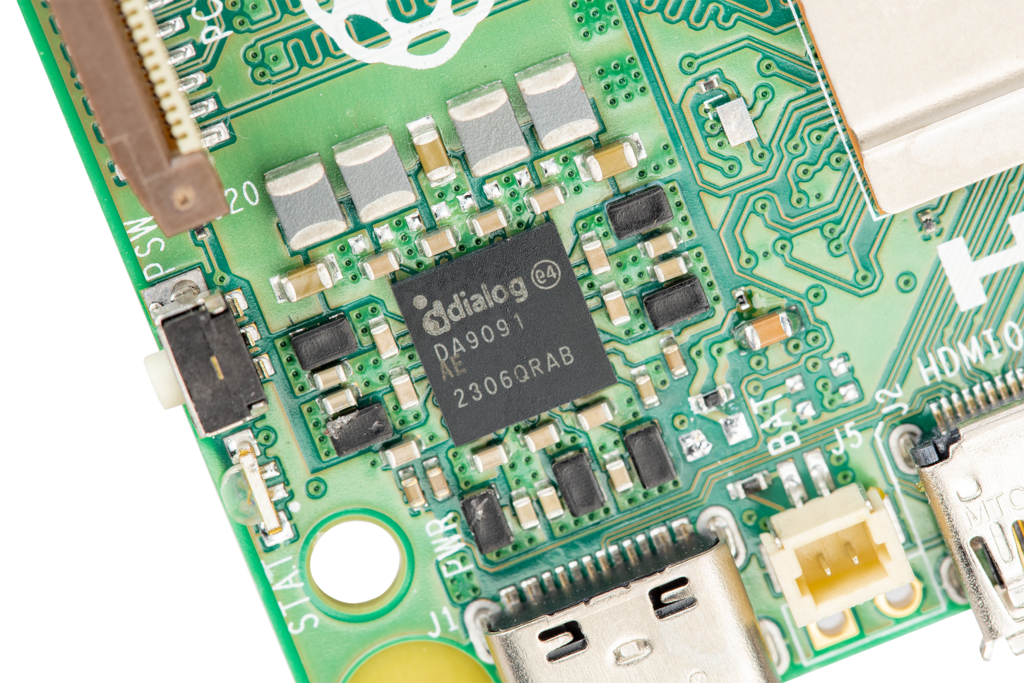

Se mantiene el chip de conectividad inalámbrica, que proporciona soporte para Wi-Fi 5 y de Bluetooth 5.0 (con BLE), aunque se ha realizado un pequeño cambio para reducir su consumo energético y mejorar su throughput. La gestión de la alimentación también estrena un chip de Renesas que permite acceder a amperajes de hasta 20A para alimentar esos nuevos núcleos y que puedan rendir al máximo.

Pero el propio Eben Upton, creador de este miniPC y líder del proyecto, se mostraba especialmente orgulloso en este lanzamiento por el SoC RP1 diseñado por la Raspberry Pi Foundation y fabricado por TSMC. Este chip se encarga de mejorar ese ancho de banda en distintas interfaces de entrada salida como los puertos USB 3.0, los Ethernet, la interfaz GPIO y también las salidas MIPI de cámara y pantalla que permiten conectar webcams o pequeñas pantallas táctiles de forma sencilla a la Raspberry Pi.

Este chip separa sus funciones del tradicional enfoque monolítico con un AP que incluía todas esas funciones. Ahora sigue teniendo trabajo —se encarga de la interfaz de la SD, pero también de las más rápidas, la SDRAM que ofrece el doble de MT/s que la RPI 4, HDMI y PCIe— mientras que otras funciones de I/O están en un controlador separado y con una fotolitografía más barata que cumple a la perfección con los requisitos que buscaban en la RPi Foundation.

El SoC RP1 ha sido diseñado por el mismo equipo que diseño el microcontrolador RP2040 y se ha fabricado con el proceso 40LP ya veterano. Está muy lejos de los avanzados procesos fotolitográficos de los modernos chips actuales, pero no persigue los mismos objetivos y se centra en ese ancho de banda de la entrada/salida. Su desarrollo es el más importante que ha afrontado esta empresa, que ha invertido 15 millones de dólares en su diseño y desarrollo.

El diseño de la Raspberry Pi es similar a sus predecesores y mantiene ese formato de "tarjeta de crédito". Aún así, hay cambios: se eliminan los conectores de vídeo compuesto —aún disponible desde la placa con un pequeño conector especial— y el puerto de auriculares.

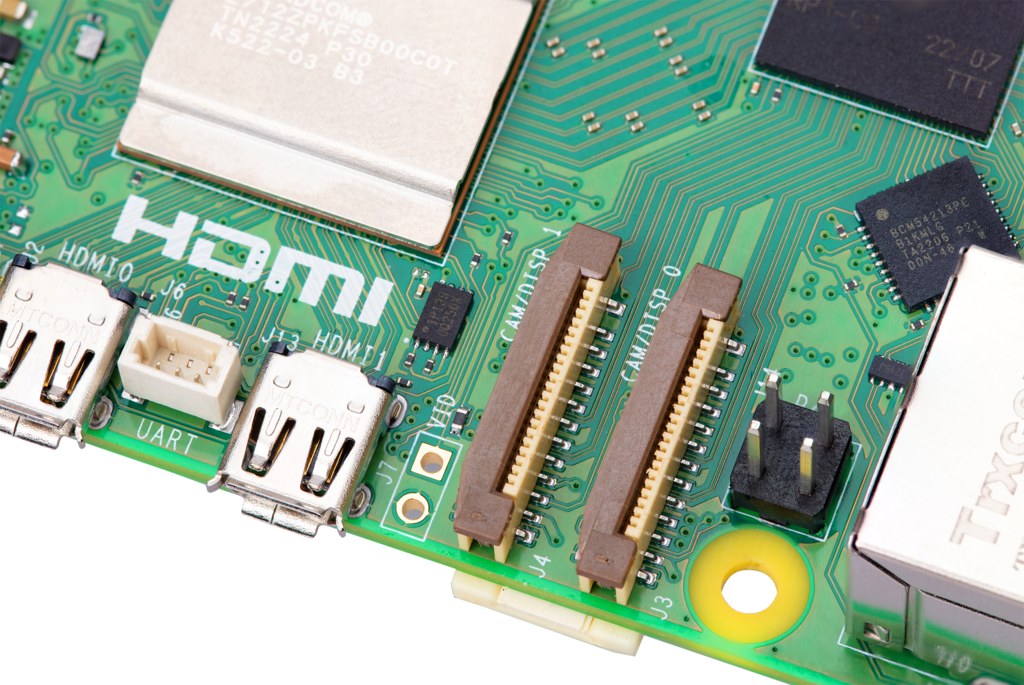

Hay ahora dos conectores FPC que son interfaces MIPI de cuatro pistas, pudiendo ser usados para conectar cámaras y pantallas. También es posible conectar dispositivos PCIe 2.0 x1. Eso, gracias a un accesorio adicional en formato HAT que aparecerá a principios de 2024, permitirá conectar unidades SSD M.2 y otros accesorios de este tipo.

El conector Gigabit Ethernet vuelve a su posición original en la esquina inferior derecha de la placa, algo que se modificó en la Raspberry pi 4. Además cuenta con un conector Power over Ethernet (PoE) de cuatro pines, lo que permite simplificar el diseño de la placa pero hace que se rompa la compatibilidad con los actuales accesorios (y el "HAT") que tenían para PoE en las RPi anteriores.

En la Raspberry Pi Foundation también han tenido en cuenta a quienes buscan exprimir a fondo estos miniPCs, y han incluido una serie de agujeros para montar disipadores adicionales y sistemas de refrigeración algo más ambiciosos.

En la Raspberry Pi Foundation tendrán además disponibles una serie de accesorios para sacar más partido al miniPC. Por ejemplo, una caja (10 dólares), un ventilador activo (5 dólares), una fuente de alimentación con conector USB-C de 27 W (12 dólares) que permite aprovechar todo el margen de maniobra del nuevo SoC, y cables para la cámara o pantalla MIPI, además del nuevo PoE HAT o el futuro M.2 HAT para las citadas unidades SSD M.2.

Hay además sorpresas muy agradables y muy demandadas por los usuarios: en la placa encontraremos tanto un reloj en tiempo real —que se puede alimentar con una pila recargable de litio-manganeso o con un supercondensador externo (venderán uno), y, atención, un botón de encendido y apagado que soporta tanto el apagado "duro" como el apagado "suave" además de eventos para el encendido.

Para completar este conjunto, en la Raspberry Pi Foundation han anunciado la inminente aparición del nuevo Raspberry Pi OS con nombre en clave "Bookworm". El sistema operativo oficial de las Raspberry Pi basado en Debian/Raspbian contará con mejoras como la transición del sistema X11 a Wayfire Wayland en las RPi 4 y RPi 5. Se espera que esta nueva versión esté disponible a mediados de octubre, aunque ya es posible instalar versiones preliminares.

Precio y versiones de la Raspberry Pi 5

La nueva Raspberry Pi 5 estará disponible a finales de octubre, y estará inicialmente preparada con dos versiones:

Raspberry Pi 5 (4 GB de RAM): 60 dólares

Raspberry Pi 5 (8 GB de RAM): 80 dólares

Vía | Raspberry Pi 5: características, precio y ficha técnica (xataka.com)

https://bit.ly/3PXJCAg