Esto no es una teoría de conspiración ni una profecía futura. La idea de un internet dominado por contenido generado por inteligencia artificial ya está ocurriendo y no se ve bien.

Desde que ChatGPT llegó al mercado, el contenido generado por inteligencia artificial ha estado filtrándose de manera constante en internet. La inteligencia artificial ha existido durante décadas, pero ChatGPT, dirigido al consumidor, ha llevado la IA al ámbito público, creando un acceso sin precedentes a modelos de IA avanzados y generando una demanda que las empresas están ansiosas por capitalizar.

Como resultado, tanto empresas como usuarios están utilizando la inteligencia artificial generativa para producir grandes volúmenes de contenido. Si bien la preocupación inicial es la abundancia de contenido con inexactitudes, disparates y desinformación, el efecto a largo plazo es la degradación completa del contenido web en basura inútil.

Basura entra, basura sale

Si piensas que internet ya contiene mucha basura inútil, eso es cierto, pero esto es diferente. "Hay mucha basura por ahí... pero tiene una cantidad increíble de variedad y diversidad", dijo Nader Henein, VP analista de la firma de consultoría de gestión Gartner. A medida que los modelos de lenguaje de aprendizaje (LLM) se alimentan del contenido de los demás, la calidad empeora y se vuelve más vaga, como una fotocopia de una fotocopia de una imagen.

Piénsalo de esta manera: la primera versión de ChatGPT fue el último modelo entrenado totalmente con contenido generado por humanos. Cada modelo desde entonces contiene datos de entrenamiento que tienen contenido generado por IA, que es difícil de verificar o incluso rastrear. Esto se vuelve en datos poco confiables, o dicho llanamente, basura. Cuando esto sucede, "perdemos calidad y precisión del contenido, y perdemos diversidad", dijo Henein, quien investiga protección de datos e inteligencia artificial. "Todo empieza a parecerse a lo mismo".

Es lo que Henein llama "aprendizaje incestuoso". "Los LLM son una gran familia, simplemente consumen el contenido de los demás y se cruzan, y con cada generación tienes... cada vez más basura hasta que la basura supera al buen contenido y las cosas comienzan a deteriorarse desde ahí".

A medida que se publica más contenido generado por IA en la web, y ese contenido es generado por LLM entrenados con contenido generado por IA, estamos viendo un futuro en el que la web será completamente homogénea y totalmente poco confiable. Además, simplemente aburrida.

Colapso del modelo, colapso de internet

La mayoría de las personas ya sienten que algo no está bien.

https://twitter.com/connorratliff/status/1750946557606674596?ref_src=twsrctfwtwcamptweetembedtwterm1750946557606674596twgr77026b0fc3dc0f5a5517566ca5c59804a4b4f8detwcons1_&ref_url=httpsmashable.comarticleai-generated-internet-era-already-here

En algunos ejemplos más destacados, el arte está siendo duplicado por robots. Los libros están siendo absorbidos por completo y replicados por LLM sin el permiso de los autores. Se crean imágenes y videos que utilizan las voces y semejanzas de celebridades sin su consentimiento y compensación.

Pero las leyes de derechos de autor e propiedad intelectual ya están en su lugar para proteger tales violaciones. Además, algunos están adoptando la colaboración con la IA, como Grimes, quien ofrece acuerdos de participación en ingresos con creadores de música de IA y compañías discográficas que exploran acuerdos de licencia con empresas tecnológicas de IA. En el ámbito político, legisladores han presentado la Ley No a los Falsos para proteger a las figuras públicas de réplicas de IA. Las regulaciones para solucionar todos estos problemas aún no están en su lugar, pero al menos es imaginable solucionarlos.

La caída en la calidad general de todo en línea, sin embargo, es un fenómeno más insidioso, y los investigadores han demostrado por qué está a punto de empeorar.

En un estudio de la Universidad de Johannes Gutenberg en Alemania, los investigadores encontraron que "este bucle de entrenamiento autodestructivo mejora inicialmente tanto la calidad como la diversidad", lo que coincide con lo que probablemente sucederá a continuación. "Sin embargo, después de algunas generaciones, la producción inevitablemente degenera en diversidad. Descubrimos que la tasa de degeneración depende de la proporción de datos reales y generados".

Otros dos artículos académicos publicados en 2023 llegaron a la misma conclusión sobre la degradación de los modelos de IA cuando se entrenan con datos sintéticos, también conocidos como datos generados por IA. Según un estudio de investigadores de Oxford, Cambridge, Imperial College London, University of Toronto y University of Edinburgh, "el uso de contenido generado por el modelo en el entrenamiento provoca defectos irreversibles en los modelos resultantes, donde las colas de la distribución de contenido original desaparecen", refiriéndose a esto como "colapso del modelo".

De manera similar, los investigadores de Stanford y Rice University dijeron: "sin suficientes datos reales frescos en cada generación de un bucle autófago , los futuros modelos generativos están condenados a que su calidad (precisión) o diversidad (recuerdo) disminuyan progresivamente".

La falta de diversidad, explica Henein, es el problema fundamental, porque si los modelos de IA están tratando de reemplazar la creatividad humana, se están alejando cada vez más de eso.

El internet generado por IA en resumen

A medida que se avecina el colapso del modelo, el internet generado por IA ya ha llegado.

Amazon tiene una nueva función que proporciona resúmenes generados por IA de las reseñas de productos. Herramientas de Google y Microsoft utilizan la IA para ayudar a redactar correos electrónicos y documentos, e Indeed lanzó una herramienta en septiembre que permite a los reclutadores crear descripciones de trabajo generadas por IA. Plataformas como DALL-E 3 y Midjourney permiten a los usuarios crear imágenes generadas por IA y compartirlas en la web.

Ya sea que proporcionen directamente contenido generado por IA como Amazon o ofrezcan un servicio para que los usuarios publiquen su propio contenido generado por IA como Google, Microsoft, Indeed, OpenAI y Midjourney, ya está ahí.

Y esos son solo las herramientas y características de las grandes empresas tecnológicas que pretenden tener algún tipo de supervisión. Los verdaderos perpetradores son sitios de clics que generan contenido reciclado de baja calidad en grandes volúmenes para obtener una alta clasificación en SEO y generar ingresos.

Un informe reciente de 404 Media encontró numerosos sitios "que copian a otras publicaciones al utilizar la IA para generar rápidamente contenido". Para obtener una muestra de este tipo de contenido, que evita el plagio a expensas de la coherencia, mira el cuestionable sitio de noticias Worldtimetodays.com, donde la primera línea de una historia de 2023 sobre el despido de Gina Carano de Star Wars dice: "Ha pasado un tiempo desde que Gina Carano comenzó una diatriba contra Lucasfilm después de ser despedida de la guerra de las estrellas, así que para bien o para mal, estábamos atrasados".

En Google Scholar, los usuarios descubrieron un conjunto de documentos académicos que contienen la frase "como un modelo de lenguaje de IA", lo que significa que partes de los documentos, o incluso documentos enteros, fueron escritos por chatbots como ChatGPT. Los documentos de investigación generados por IA, que se supone que tienen alguna credibilidad académica, pueden llegar a sitios de noticias y blogs como referencias autorizadas.

https://twitter.com/itsandrewgao/status/1689634145717379074?ref_src=twsrctfwtwcamptweetembedtwterm1689634145717379074twgr77026b0fc3dc0f5a5517566ca5c59804a4b4f8detwcons1_&ref_url=httpsmashable.comarticleai-generated-internet-era-already-here

Incluso las búsquedas en Google ahora a veces muestran semejanzas generadas por IA de celebridades en lugar de fotos de prensa o capturas de pantalla de películas. Cuando buscas a Israel Kamakawiwo'ole, el difunto músico conocido por su versión en ukelele de "Over the Rainbow", el resultado principal es una predicción generada por IA de cómo se vería Kamakawiwo'ole hoy si estuviera vivo.

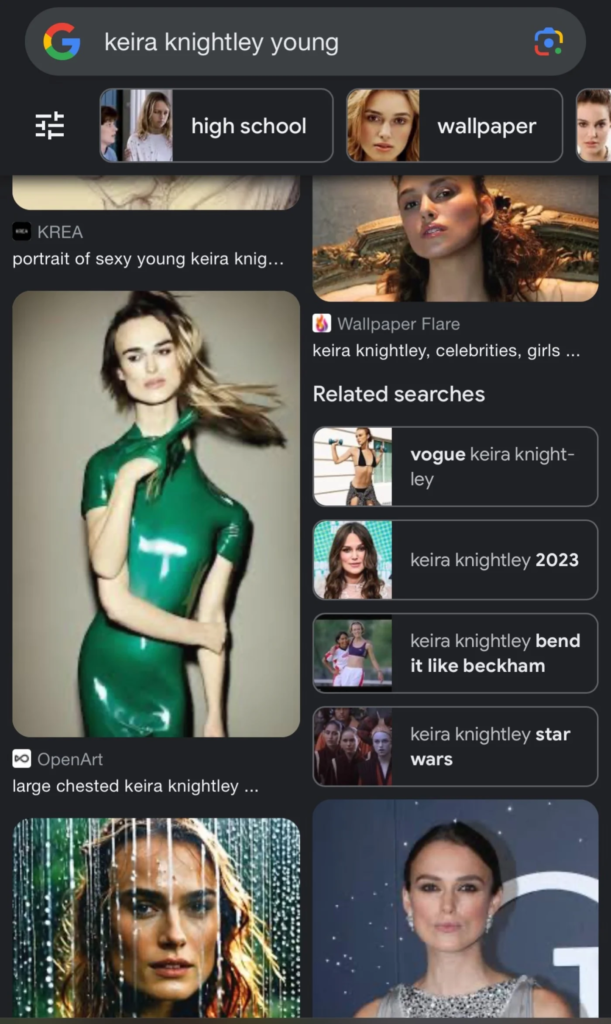

Las búsquedas de imágenes de Keira Knightley en Google muestran representaciones distorsionadas subidas por usuarios en OpenArt, Playground AI y Dopamine Girl junto con fotos reales de la actriz.

Sin mencionar los deepfakes pornográficos recientes de Taylor Swift, un anuncio en Instagram que utiliza la imagen de Tom Hanks para vender un plan dental, una aplicación de edición de fotos que utiliza la cara y la voz de Scarlett Johansson sin su consentimiento, y esa canción pegajosa de Drake y The Weeknd que resultó ser un deepfake de audio no autorizado que sonaba exactamente como ellos.

Si nuestros resultados de búsqueda en el motor ya no son confiables y los modelos casi con seguridad se alimentan de esta basura, hemos cruzado el umbral hacia la era de la basura de la IA en la web. Por el momento, la web como la conocíamos todavía es algo reconocible, pero las advertencias ya no son abstractas.

El internet no está completamente condenado

Suponiendo que productos como ChatGPT no logren un milagro y comiencen a generar de manera confiable contenido vibrante y emocionante que los humanos realmente encuentren placentero o útil de consumir, ¿qué sucede después?

Espera que las comunidades y las organizaciones contraataquen protegiendo su contenido de los modelos de IA que intentan absorberlo. Si bien la web abierta, respaldada por anuncios y basada en búsquedas, podría estar desapareciendo, la internet evolucionará. Espera que más sitios de medios de confianza pongan su contenido detrás de muros de pago y que la información confiable provenga de boletines de suscriptores.

Espera ver más batallas de derechos de autor y licencias, como la demanda de The New York Times contra Microsoft y OpenAI. Espera ver más herramientas como Nightshade, una herramienta invisible que protege imágenes con derechos de autor al intentar corromper modelos entrenados con ellas. Espera el desarrollo de nuevas y sofisticadas herramientas de marca de agua y verificación que eviten el scraping de la IA.

Por otro lado, también puedes esperar que otros medios de noticias como Associated Press, y posiblemente CNN, Fox y Time, adopten la IA generativa y negocien acuerdos de licencia con empresas como OpenAI.

A medida que herramientas como ChatGPT y SGE de Google se conviertan en sustitutos de las búsquedas tradicionales, espera que los modelos de ingresos basados en SEO cambien.

La ventaja del colapso del modelo, sin embargo, es la pérdida de demanda. La proliferación de la IA generativa actualmente está dictada por la emoción, y si los modelos entrenados con contenido de baja calidad ya no son útiles, la demanda se agota. Lo que (esperamos) permanece son nosotros, humanos de mente débil, con el impulso inagotable de despotricar, compartir en exceso, informar y expresarnos de alguna manera en línea.

Vía | The era of the AI-generated internet is already here | Mashable

https://bit.ly/3SBR58v

No hay comentarios.:

Publicar un comentario